[파이낸셜뉴스] KAIST(한국과학기술원) 연구진이 비싼 데이터센터 그래픽처리장치(GPU)를 덜 쓰고, 주변에 있는 저렴한 GPU를 활용해 인공지능(AI) 서비스를 더 싸게 제공할 수 있는 기술을 개발했다.

KAIST는 전기및전자공학부 한동수 교수 연구팀이 데이터센터 밖에 널리 보급된 저렴한 소비자급 GPU를 활용해 대규모 언어모델(LLM) 인프라 비용을 크게 낮출 수 있는 새로운 기술 ‘스펙엣지(SpecEdge)’를 개발했다고 28일 밝혔다. LLM 기반 AI 서비스는 지금까지 대부분 고가의 데이터센터 GPU에 의존해 서비스 운영 비용이 높고, AI 기술 활용의 진입장벽도 컸다.

이번에 개발한 SpecEdge는 데이터센터 GPU와 개인 PC나 소형 서버 등에 탑재된 ‘엣지 GPU’가 역할을 나눠 LLM 추론 인프라를 함께 구성하는 방식이다. 이 기술을 적용한 결과, 기존 데이터센터 GPU만 사용하는 방식에 비해 토큰(AI가 문장을 만들어내는 최소 단위)당 비용을 약 67.6% 절감할 수 있었다.

연구팀은 이를 위해 ‘추측적 디코딩(Speculative Decoding)’이라는 방법을 활용했다. 엣지 GPU에 배치된 소형 언어모델이 확률이 높은 토큰 시퀀스(단어 또는 단어 일부가 순서대로 이어진 형태)를 빠르게 생성하면, 데이터센터의 대규모 언어모델이 이를 일괄 검증하는 방식이다. 이 과정에서 엣지 GPU는 서버의 응답을 기다리지 않고 계속 단어를 만들어, LLM 추론 속도와 인프라 효율을 동시에 높였다.

데이터센터 GPU에서만 추측적 디코딩을 수행하는 방식과 비교해 비용 효율성은 1.91배, 서버 처리량은 2.22배 향상됐다. 특히 일반적인 인터넷 속도에서도 문제없이 작동해, 별도의 특수한 네트워크 환경 없이도 실제 서비스에 바로 적용할 수 있는 기술임을 확인했다.

또 서버는 여러 엣지 GPU의 검증 요청을 효율적으로 처리하도록 설계돼 GPU 유휴 시간 없이 더 많은 요청을 동시에 처리할 수 있다. 이를 통해 데이터센터 자원을 보다 효율적으로 활용할 수 있는 LLM 서빙 인프라 구조를 구현했다는 설명이다.

향후 스마트폰, 개인용 컴퓨터, 신경망 처리장치(NPU) 등 다양한 엣지 기기로 확장될 경우, 고품질 AI 서비스가 보다 많은 사용자에게 제공될 수 있을 것이라는 기대다.

한동수 교수는 “데이터센터를 넘어 사용자의 주변에 있는 엣지 자원까지 LLM 인프라로 활용하는 것이 목표”라며 “이를 통해 AI 서비스 제공 비용을 낮추고, 누구나 고품질 AI를 활용할 수 있는 환경을 만들고자 한다”고 말했다.

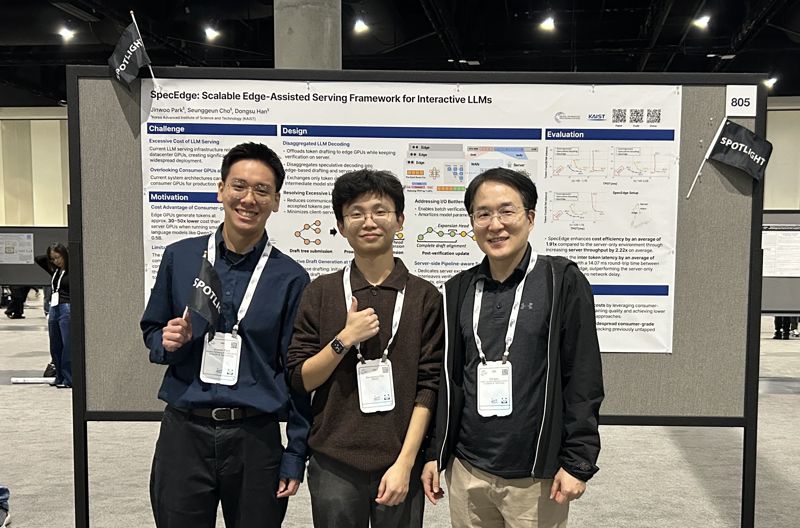

이번 연구 결과는 12월 2일부터 7일까지 미국 샌디에이고에서 열린 인공지능 분야 최고 권위 국제 학회인 신경정보처리시스템 학회(NeurIPS)에서 스포트라이트(Spotlight)로 (상위 3.2% 논문, 채택률 24.52%) 발표됐다.

jiany@fnnews.com 연지안 기자

※ 저작권자 ⓒ 파이낸셜뉴스, 무단전재-재배포 금지