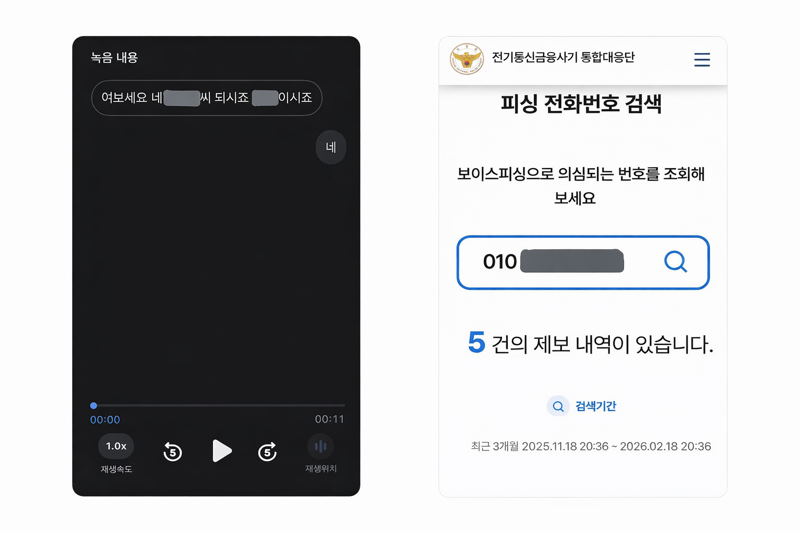

20대 직장인 A씨도 유사한 사례다. A씨는 최근 모르는 번호로 걸려온 전화에서 "000씨 되시죠?"라는 질문을 받고 "네"라고 대답했다.

"3초면 녹취해 보이스피싱 가능"

20일 보안업계에 따르면 최근 보이스피싱 조직이 피해자 음성 샘플을 AI로 재현해 금전을 편취하는 수법이 확산하고 있다. 짧은 통화나 사회관계망서비스(SNS)에 피해자가 게시한 영상 등도 AI 음성 복제에 이용된다. 수 초 분량의 샘플만으로도 목소리를 재현할 수 있어 피해자가 속을 가능성이 크다는 우려가 나온다.

보안기업 맥아피에 따르면 3초 분량의 음성만 확보해도 원본과 최대 85%까지 유사한 딥페이크 음성을 만들어낼 수 있다. 이는 피해자 자녀나 지인의 목소리를 흉내 내 교통사고·납치·강도 피해를 당했다는 식으로 긴급 상황을 꾸며 돈을 요구하는 범죄에 악용되고 있다. 딥페이크 사기로 인한 금전 피해도 폭증했다. 보안기업 서프샤크는 음성 복제를 포함한 딥페이크 사기 피해 규모가 2020~2023년 누적 1850억원 수준에서 2024년 약 5204억원, 2025년에는 약 1조 5901억원으로 급증했다고 집계했다. 또 보안기업 킵넷에 따르면 지난해 음성 딥페이크 제작은 전년 대비 680% 늘었다. 오픈소스나 무료 앱 등으로 누구나 쉽게 딥페이크를 제작할 수 있어 진입 장벽이 낮아진 것으로 풀이된다.

"AI 탐지기술로 방어책 마련해야"

전문가들은 이용자들이 최대한 수상한 전화에 응답을 피하고 보이스피싱 관련 앱을 적극 이용할 것을 권장하고 있다.

앱이 무방비로 전화를 걸어 음성 샘플을 확보하는 공격자의 행위 자체를 차단할 수는 없지만, 음성이 악용됐을 경우 사기 시도는 차단할 수 있기 때문이다. 라온시큐어 관계자는 "짧은 단어나 발화만으로도 복제가 가능하며 상황에 따라 피해자가 가족의 목소리와 유사하다고 느낄 수 있다"며 "전화·금융·플랫폼 서비스 차원에서 AI 탐지 기술을 적용해 위협을 완화해야한다"고 설명했다. 과학기술정보통신부는 최근 SKT의 '에이닷', KT의 '후후', LG U+의 '익시오' 등 AI가 통화 맥락을 파악해 보이스피싱을 탐지하고 이용자에게 경고하는 서비스를 활용할 것을 당부한 바 있다.

kaya@fnnews.com 최혜림 기자

※ 저작권자 ⓒ 파이낸셜뉴스, 무단전재-재배포 금지